最后更新于: 2025年4月4日

字节跳动火山引擎提供的DeepSeek满血版服务很实在,尤其是其服务非常稳定,还能支持联网搜索。

不过,当我尝试把火山引擎的DeepSeek R1联网应用API放到第三方客户端去使用时,遇到了很多问题。

这里先澄清几个基本概念,免得大家理解起来云里雾里的。

大模型本身默认是不支持联网的,所谓联网搜索其实是应用层的能力。举例,月之暗面公司的Kimi API是不能联网搜索的,但是你在Kimi的官网直接使用,为啥能联网?那是因为官方做了功能处理,Kimi才能联网,其他大模型也是类似的。

所以在火山引擎后台,你可以看到两个不同但又有联系的东西,一个叫做推理接入点,它是基于模型创建的(例如不能联网的DeepSeek模型):

另一个叫做“应用”,它是基于推理接入点创建得到的,可以配合其他插件,如联网内容插件来强化功能:

模型与应用都分别支持API调用,但调用方法略有不同,参考OpenAI SDK调用示例:

DeepSeek R1模型(不联网)

- base_url:https://ark.cn-beijing.volces.com/api/v3

- model:ep开头的一串字符

DeepSeek R1联网应用

- base_url:https://ark.cn-beijing.volces.com/api/v3/bots

- model:bot开头的一串字符

问题就出在这个联网应用比较特殊,很多第三方工具对其兼容做得不够完善,有时候还要对base_url或者模型名称做一些手动修改之类的。

我找了很久,总算是找到几个能用的客户端,这里和大家分享下。

这款客户端更新频率极高,三天两头发版一次,难怪能完美兼容火山引擎DeepSeek R1联网应用API。

非常重要:请注意上图,API地址中,尾部有个 / 符号!

2、使用New API中转后兼容OpenAI格式的客户端

2.1 什么是New API

之前我有介绍过One API这款API中转程序,后来发现New API也挺不错的,关键是最新版的New API支持对火山引擎的DeepSeek模型和应用做中转处理。

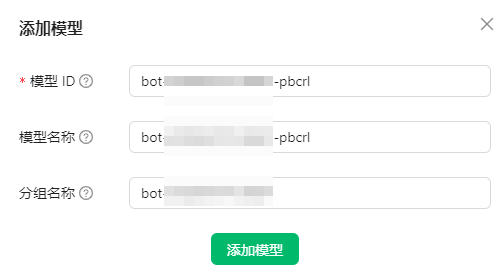

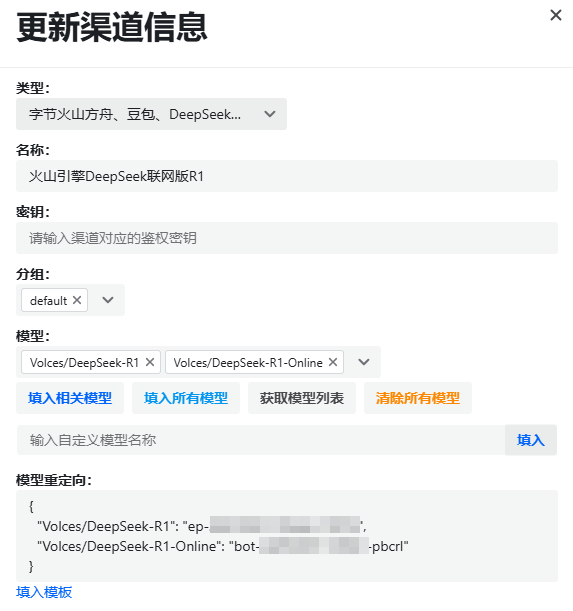

我参考的帖子来自这里,详细设置截图如下:

如何理解上面这张图的设置?最重要的就是模型重定向,即,自定义一个可以在第三方客户端中使用的模型名字,然后在API接口请求时,中转到火山引擎实际对应的DeepSeek模型/应用的真正名称(model id)。

接下来,就可以在那些支持兼容OpenAI API格式的第三方客户端中,使用New API中转过后的火山引擎DeepSeek R1模型(不联网)或者联网版应用。

ChatHub是一款我非常喜欢的浏览器扩展,平时经常在电脑上办公,肯定会开着Chrome浏览器,那装个扩展随手用是很方便的。

在ChatHub设置界面,添加一个自定义的机器人,选择兼容OpenAI模式:

API的base url就是自行搭建的New API中转站网址,API Key也是中转站的Key,模型名记得准确填写在New API中自定义的名字。

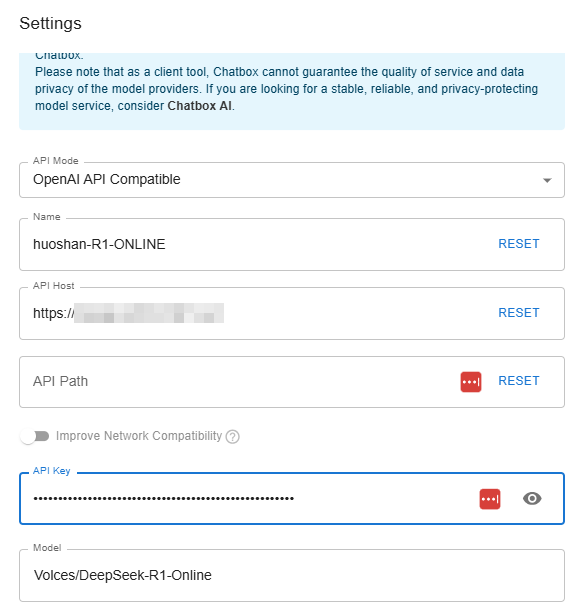

Chatbox也是另一款很受欢迎的本地客户端,他们是不提供自部署服务的,但官方也提供了一个Web版本供大家使用,我个人其实更喜欢网页版。

我测试了一下在Chatbox网页版上添加New API中转后的配置,证实也能完美支持火山引擎DeepSeek R1联网版API的使用:

2.4 NextChat(原名ChatGPT Next Web)网页版

这款大名鼎鼎的网页版自部署应用,应该是从ChatGPT问世以来最知名的套壳应用了吧,也是我平时用得很多的客户端。

我试了下,在NextChat上添加New API中转后的配置,能用火山引擎DeepSeek R1联网版API,只是无法展示思维链。搜索了一下官方Github issues,发现有人提到这个问题,估计后续版本会完善吧。

其他补充:

- 有部分第三方客户端采用外挂插件的方式来支持大模型的联网,但我感觉不如火山引擎那样对DeepSeek联网能力处理的效果好。

- 如何测试联网能力?搜一下时效性比较强的问题就行,例如哪吒2的最新票房是多少。

- 火山引擎DeepSeek R1联网应用中,如果开启联网内容插件,内容源务必记得只勾选“搜索引擎”,其他不要选,因为容易产生不必要的开销(参考:联网内容插件产品计费)。

求问,我在deepseek联网应用模板中,只要填入推理接入点,不管是deepseek还是字节自家的豆包模型,联网内容插件都会变成关闭的状态,无法打开,我这是有什么地方没有设置吗?

我是在火山引擎的首页(概览页),从那个快速创建专属模型应用(DeepSeek-R1 联网搜索版)点击进去的,使用自定义推理接入点(之前没建过的话可以先建一个),在这个创建应用的界面就可以直接点击打开联网内容插件的开关了。您可以看看重新建一个联网版应用?或者新建一个推理接入点试试。